告别内网穿透!蓝莺ClawChat,让你的OpenClaw全渠道在线!

相信很多朋友和我一样,刚接触龙虾机器人OpenClaw🦞 [1]的时候,心里想的都是怎么把它调教成一个随叫随到的专属 AI 助理。

但真正上手玩起来,我们往往会立刻卡在两个最折磨人的地方:

第一个痛点,是怎么随时随地连上它。

平时在同一个局域网下跑通很容易,可一旦出了门,想用手机给它发个消息、下个指令,就傻眼了。为了让它随时在线,我们要么去折腾各种内网穿透工具、搞端口映射;要么就得去研究怎么接入 QQ 机器人或者其他的第三方消息通道。且不说内网穿透网络稍微一波动就断联,单是去搞定 QQ 机器人那一套复杂的协议、鉴权和审核,就足够脱层皮了。本想拥有个聪明的助理,结果自己变成了全职网络运维,心力交瘁。

第二个痛点,是怎么低门槛地让它变聪明。

框架搭好了,总不能只让它按写死的脚本跑。我们都想给它接个最强的大模型,甚至让它读一读个人的笔记、公司的业务文档。但真操作起来才发现配置极其繁琐:挑模型、接 API、手写复杂的提示词;要是想搞文档问答(知识库 RAG),还得自己去部署一套向量检索服务。这一通底层工程折腾下来,很多人耐心耗尽,让项目直接吃灰了。

说白了,我们只是想好好玩个 AI 助理,不想在基础配置上掉头发。

正因为我们自己也踩了这些坑,所以才开发了龙虾对话(ClawChat)插件。

它的逻辑非常直接,就是帮大家把这两件最麻烦的事给“平替”掉:装上插件,你的 OpenClaw 就能直接连上云端。不管你在哪,用蓝莺 App、微信小程序或者网页,随时都能直接和它对话,彻底告别内网穿透和配置第三方 Bot 的烦恼。

同时,大模型和知识库的接入也全挪到了蓝莺的控制台上,点几下鼠标,选个模型、传个文档,你的专属助理就配置好了。

今天就和大家分享一下,我们是怎么用 ClawChat 让手里的 OpenClaw 瞬间“满血”走向全渠道的。操作很简单,跟着下面的步骤走就行。

💡 设计思路

ClawChat 的设计初衷,是将“通信通道”与“云端算力”无缝注入到龙虾中,主要体现在以下四个维度:

1. 突破局域网限制,实现全渠道在线

传统的硬件控制往往依赖于局域网或繁琐的内网穿透(NAT)配置。ClawChat 底层依托蓝莺 IM 的全球消息路由架构,将机器人作为一个独立的“客户端”接入消息云。

只要机器人能连接公网,开发者就可以直接通过蓝莺 IM App、微信小程序、H5 等全端渠道与机器人建立长连接,随时随地进行状态监听与指令下发。

2. 开箱即用,直接配置多模态大模型

边缘设备的算力瓶颈不应限制机器人的智商。通过 ClawChat,我们可以将硬件控制逻辑与 LLM 推理彻底解耦。在蓝莺云端,开发者可以直接为机器人配置所需的大语言模型(如 GPT-4、Claude 或蓝莺自研模型)。

所有的复杂计算、上下文窗口管理都在云端完成,硬件端只需通过轻量级的插件即可接收解析后的结构化指令和自然语言回复。

3. 满足企业级安全,严格的提示词与边界控制

当机器人接入公网并面向更广泛的用户时,安全性是企业落地的底线。ClawChat 配合蓝莺控制台,支持设置严格的企业级安全提示词(System Prompts)。系统在底层设计上严格分离了动态对话状态与核心系统指令。

无论用户在多轮对话中如何尝试“越狱”或更改设定,只要核心的 Agent 配置保持不变,机器人的安全边界就不会被突破,确保其始终遵循企业的安全合规要求。

4. 深度集成 RAG,外挂企业专属知识库

通用大模型不懂企业内部业务。ClawChat 原生支持蓝莺 AI 的 RAG(检索增强生成)管道。你可以直接将产品说明书、设备维修手册或企业业务文档以 PDF 或 Word 形式导入知识库。

在交互时,云端会自动进行向量检索与上下文组装,让你的龙虾机器人瞬间成为精通内部业务的专属专家。

🛠 操作指南:三步完成 ClawChat 接入

本指南假设您已拥有龙虾机器人硬件(Linux / Mac / 树莓派环境),并已注册了蓝莺IM控制台账号。

第一步:在云端配置机器人的“数字身份”

要让机器人接入网络,首先需要为其分配鉴权凭证。

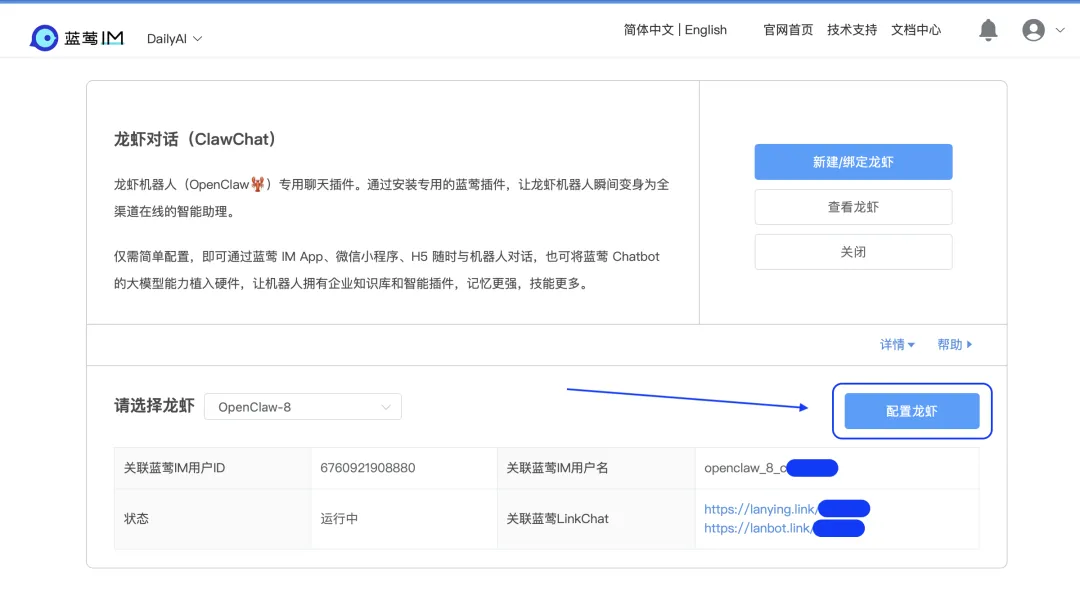

1. 登录 蓝莺IM控制台 [2],选择应用(DemoAPP或其他)进入。

2. 导航至AI智能版块,找到 龙虾对话(ClawChat)服务。

3. 点击新建/绑定龙虾,系统将自动分配一个关联蓝莺IM用户ID。

4. 点击配置龙虾,按后续步骤操作即可。

第二步:在龙虾终端或Dashboard安装与配置插件

ClawChat 的硬件端接入基于开源项目 openclaw-channel-clawchat,对开发者极为友好。

1. 终端接入:通过 SSH 登录到您的龙虾机器人控制端。

2. 安装依赖:运行以下命令安装 ClawChat 插件包:

openclaw plugins install @lanying/clawchat

3. 注入配置:将第一步中获取的凭证信息写入 OpenClaw 配置。(提示:在蓝莺控制台可直接复制这段完整 JSON 命令):

openclaw config set channels.clawchat '

{

"enabled": true,

"appId": "您的AppID",

"username": "关联蓝莺IM用户ID",

"password": "关联蓝莺IM用户密码",

"dmPolicy": "open",

"allowFrom": ["*"],

"groupPolicy": "open",

"groupAllowFrom": ["*"],

"groups": {

"*": { "requireMention": true }

},

"allowManage": true

}'

配置写入后,重启 OpenClaw 服务。此时,底层 WebSocket 连接已建立,机器人正式上线。

第三步:注入灵魂(配置大模型与企业知识库)

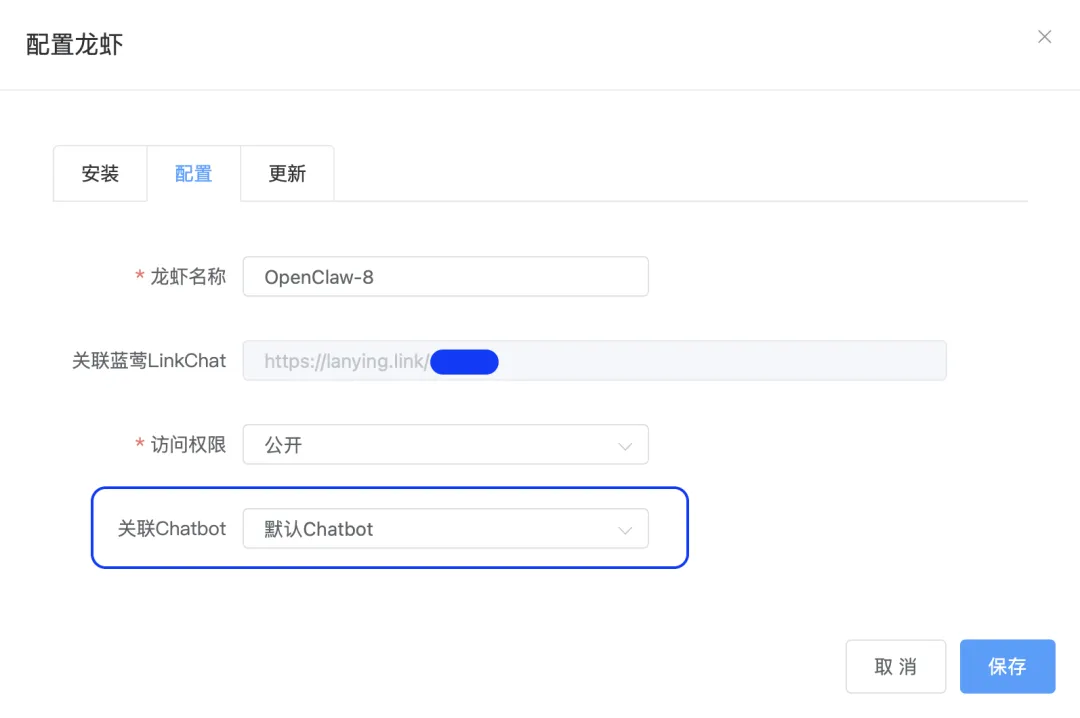

回到蓝莺控制台,为这台刚刚上线的机器人配置“大脑”:

1. 进入Clawchat版块,将刚才创建的 ClawChat 实例与 Chatbot 关联,则Chatbot的提示词已经大模型配置均可同步到OpenClaw。

2. 进入智能消息版块,可进行模型与提示词配置:选择基座模型,并设定核心的 System Prompt,确保安全边界。

3. RAG 注入:在知识库管理中,上传您的业务文档。系统会自动完成切片与向量化。相关操作可继续阅读《上传文档构建企业知识库》。

注意:如果ClawChat与Chatbot绑定,两个服务的蓝莺Link均可聊天,区别在于,只有Chatbot的蓝莺Link可以带上知识库,ClawChat的蓝莺Link是与龙虾直接交流,可以用来测试。

🚀 联调测试:全渠道操控

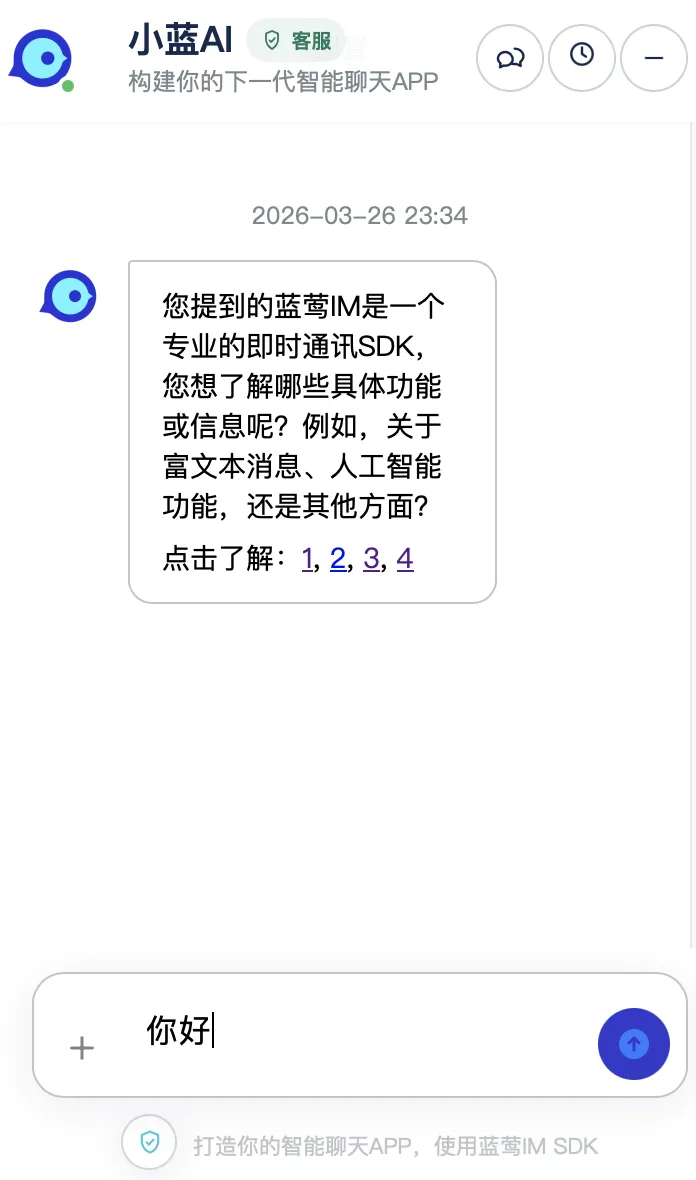

环境部署完毕。现在,您可以通过 ClawChat 生成的专属蓝莺Link,或者直接打开蓝莺 IM App / 微信小程序。

在联系人列表中找到“龙虾机器人”,您可以直接发送技术指令,或询问基于企业知识库的业务问题。无需任何 NAT 穿透,一次配置,全网互通。

🤖 智能集成&自带API-KEY(BYOK)

蓝莺内置集成大模型 AI 服务。企业可直接在控制台一键接入豆包、DeepSeek、智谱、Minimax、Kimi、阿里通义千问、百度文心一言、OpenAI ChatGPT、Anthropic Claude等多种主流大模型。

您可以在智能消息配置页面,选择自定义供应商,设置使用自己的API-KEY。新增供应商支持:万界方舟、OpenRouter。

🤝 开源共建

蓝莺 ClawChat 旨在为龙虾机器人提供最稳定的云原生基础设施。欢迎各位开发者前往我们的 GitHub 仓库查看源码、提交 Issue 或发起 Pull Request,共同完善 OpenClaw 生态。

我们会持续分享关于智能聊天ChatAI、大模型技术进展、AI Agent设计等方面的内容,也会分享典型AI应用案例。欢迎进群一起探讨!

关于蓝莺

蓝莺 [3](由美信拓扑团队研发)是新一代智能聊天云服务。我们提供极简设计的跨平台 SDK 与开箱即用的企业级 AI 平台,服务采用云原生技术和多云架构,支持私有云按月付费。

目前,全球新出货智能手机中,每七台就有一台使用了蓝莺技术。

🚀 核心产品与服务

- 蓝莺IM:极简设计的跨平台聊天 IM SDK,助力企业快速为 APP 添加专业通信功能。

- 蓝莺AI:开箱即用的企业级 AI Agent 平台,支持构建业务 AI Agent、企业知识库及 RAG 服务。

- GrowAI:获取免费线上流量的一站式 AI SEO 工具。

- ClawChat:让你的龙虾机器人(OpenClaw 🦞)全渠道在线,覆盖 iOS & Android APP、微信小程序、Web、H5 等。